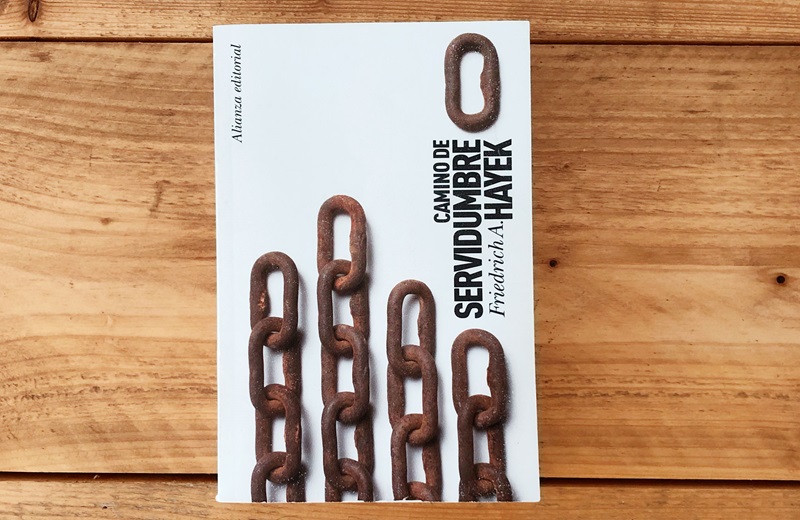

En

El camino de la servidumbre, Friedrich Hayek advirtió sobre los peligros del colectivismo y la planificación centralizada. Argumentó que cuando el poder de decisión se concentra en una autoridad central, la libertad individual se ve amenazada, allanando el camino hacia la tiranía. Hoy, esta discusión adquiere una nueva dimensión con la llegada de la inteligencia artificial (IA) en el ámbito de la toma de decisiones, donde se plantea un dilema crucial: ¿es posible una gobernanza gestionada por IA sin sacrificar la libertad individual?

IA como reemplazo de la toma de decisiones humanas

El concepto de sustituir a los humanos en la toma de decisiones por IA no es nuevo, pero ha ganado terreno gracias a los avances en machine learning y el procesamiento de datos. Sistemas de IA éticamente diseñados podrían optimizar muchas decisiones, desde la asignación de recursos hasta la regulación de mercados, eliminando el sesgo humano y aumentando la eficiencia. Pero esta perspectiva también plantea profundas inquietudes sociales y éticas que recuerdan a las advertencias de Hayek.

En el ideal de Hayek, la descentralización del poder era clave para preservar las libertades individuales. Sin embargo, las IA, por su propia naturaleza, tienden hacia la centralización: los algoritmos requieren ingentes cantidades de datos, normalmente gestionados por unas pocas corporaciones o gobiernos. Aunque estos algoritmos puedan estar diseñados bajo un marco ético, su implementación depende de aquellos que los controlan, y es aquí donde surge el dilema: ¿cómo garantizar que la toma de decisiones basada en IA no lleve a una nueva forma de

servidumbre?

La ética y moral en la IA: ¿un camino hacia la liberación?

Los defensores de una IA ética argumentan que, si se programa y entrena correctamente, una IA podría superar muchos de los problemas que Hayek vio en los sistemas de planificación centralizados. A diferencia de los humanos, las IA pueden ser entrenadas para actuar de manera objetiva, sin prejuicios, y siguiendo principios éticos predeterminados. Este tipo de IA podría tomar decisiones justas y equitativas, evitando las inclinaciones ideológicas o egoístas de los planificadores humanos.

Por ejemplo, algoritmos como los basados en

fairness y

accountability están siendo desarrollados para garantizar que los sistemas de IA no discriminen ni perpetúen las desigualdades. En teoría, esto permitiría una toma de decisiones basada en datos, imparcial y mucho más eficiente que la humana. Sin embargo, aún persisten importantes desafíos sobre la transparencia y la "auditabilidad" de estos sistemas. Los procesos de toma de decisiones por IA son a menudo opacos para los ciudadanos, lo que puede minar la confianza pública y crear una nueva forma de elitismo tecnológico.

¿Decisiones automatizadas = Pérdida de libertad?

Aquí es donde los críticos alineados con Hayek podrían expresar su preocupación. Aunque las IA pueden mejorar la toma de decisiones, hay un riesgo inherente en permitir que una máquina, por muy bien diseñada que esté, decida aspectos clave de nuestras vidas. Los sistemas de IA, por ejemplo, podrían decidir sobre el acceso a recursos como salud, educación o seguridad social, basados en cálculos optimizados y criterios predefinidos, pero no necesariamente en una comprensión humana de la justicia o el bienestar.

Este tipo de automatización podría llevar a una sensación de alienación. Si bien la tecnología se utiliza para liberar a los individuos de ciertas tareas, también puede crear una dependencia tecnológica donde los individuos pierden el control sobre las decisiones más básicas. En última instancia, la pregunta es si la delegación de poder en las máquinas, por muy objetivas que sean, podría llevar a la pérdida de nuestra agencia como seres humanos.

Diferencias con la planificación centralizada de Hayek

En contraste con la planificación centralizada a la que Hayek se oponía, la IA no necesariamente tiene que implicar una autoridad única que tome todas las decisiones. Al contrario, muchos expertos proponen modelos descentralizados de IA, en los cuales diferentes sistemas autónomos interactúan entre sí sin la necesidad de un control centralizado. Los sistemas distribuidos de IA, en teoría, podrían evitar los riesgos de concentración de poder que Hayek tanto temía, permitiendo una coordinación económica sin la intervención directa de un planificador central.

Sin embargo, el gran reto aquí es evitar la creación de un "monopolio de datos", donde un puñado de corporaciones o gobiernos acumulen suficiente poder para manipular los sistemas de IA a su favor. De hecho, la creciente concentración de datos en unas pocas manos recuerda a las advertencias de Hayek sobre los peligros de la centralización. Si bien no se trata de planificación central en el sentido tradicional, la centralización del poder en torno a los datos y la IA puede generar un nuevo tipo de servidumbre digital.

¿Se arriesgarán las empresas a implementar IA ética?

Otro aspecto que refleja las preocupaciones de Hayek es la pregunta de si las empresas realmente adoptarán la IA ética o si priorizarán la ventaja competitiva a corto plazo. En un entorno global altamente competitivo, las empresas que no adopten modelos de IA totalmente éticos podrían ganar ventajas significativas sobre aquellas que sí lo hagan. Esto plantea un desafío regulatorio y ético: ¿cómo garantizar que las IA sigan estándares morales sin que las empresas pierdan competitividad?

El riesgo es que, en la búsqueda de la eficiencia económica, se comprometan las libertades individuales y los derechos de los ciudadanos. Un sistema en el que las decisiones son tomadas por IA no reguladas podría acabar replicando, e incluso exacerbando, las dinámicas de poder centralizado que Hayek temía.

Conclusión

El enfrentamiento entre el pensamiento de Hayek y la era de la IA abre un debate fascinante sobre la relación entre libertad individual, tecnología y toma de decisiones. Si bien las IA entrenadas de manera ética pueden ofrecer grandes beneficios en términos de eficiencia y equidad, el desafío sigue siendo evitar la centralización del poder y asegurar que los humanos sigan siendo los actores principales en la configuración de su propio destino. Si fallamos en este punto, podríamos, como advirtió Hayek, estar en el

camino de la servidumbre, esta vez, a través de la inteligencia artificial.